KUBERNETES – DIE REVOLUTION FÜR SERVERANWENDUNGEN

INFOS UND KNOW-HOW AUF EINEN BLICK

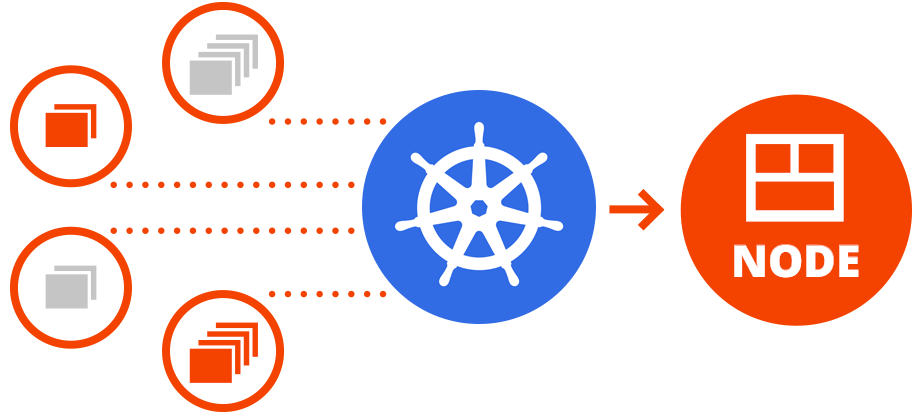

Entwickler, die Docker nutzen und ihre Anwendungen skalieren müssen, brauchen eine effiziente Lösung, um die Container-Landschaft zu managen. Da die Anzahl an Containern stetig wächst, ist eine vereinfachte und automatisierte Orchestrierung von großer Bedeutung. Nur so kann ein Überblick über alle Microservices gelingen.